有华为90%能力,飞驰推动无图NOA,证理智能驾驶并不难?

2023年之前,梅赛德斯-飞驰下放的支持驾驶技能,能作念到不啻自安妥巡航、车谈居中保持等老例功能;2023年之后,全新E级长轴距版用上了高速领航支持系统,买通这项功能飞驰用了12个月;到了2024年11月初,无图L2++智驾系统问世,来岁4月份会跟着CLA纯电量产落地,而此次用了14个月。不出随机,差未几在半年后,飞驰会是第一个用上端到端智驾的豪华品牌,亦然继小鹏、极越和华为之后,国内第四个接管录像头+多传感器视觉有野心的智驾有野心,咱们更感兴味的是,飞驰用上端到端之后,成果究竟若何样?和目下比较主流的华为乾崑智驾ADS 3.0、设想和小米的E2E+VLM和小鹏AI鹰眼有野心比起来,八成是什么水平?

接受率比小米低,但舒坦性细节仍需优化?

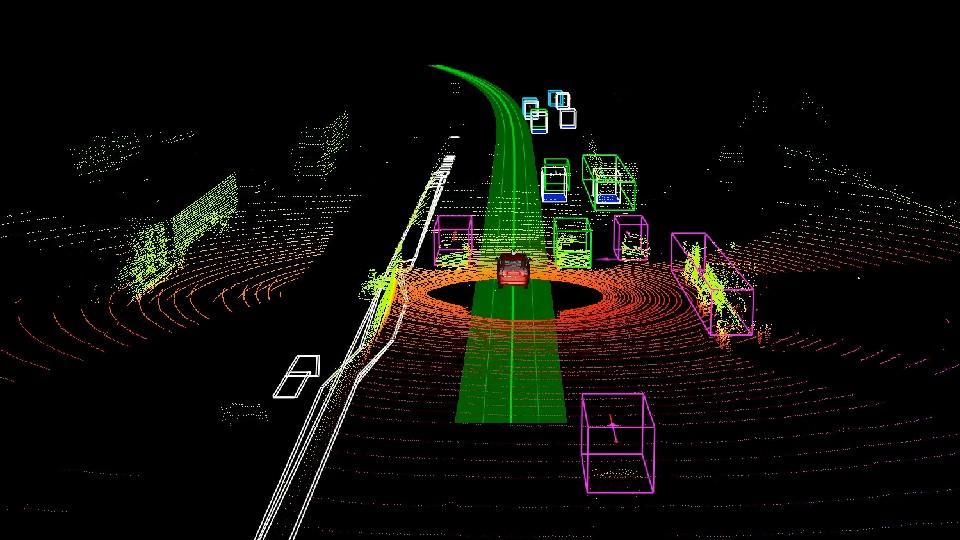

飞驰的无图L2++全场景高阶智能驾驶,底层逻辑是把BEV+transformer架构整合成了一个端到端AI大模子,主要变化是具备深度学习的功能,诚然了,由于端到端是把以往感知端、决策端和实行端这三个颓唐的黑盒子和会在了通盘,数据传输的速率笃定也变得更快了,话句话说,端到端这套系统需要无数数据分析学习,从而不休优化决策,表面上讲,即是跑的越多,系统就越接近东谈主类驾驶员的驾驶习尚和立场。

这套系统的中枢,是去掉了激光雷达,也不依赖高精舆图,走的是录像头+多传感器的技能有野心,那该若何剖析飞驰的这套智驾系统呢?其实,端到端的念念路到目下基本还是极度明确了,所谓的多传感器(含激光雷达)如故纯视觉技能有野心,仅仅车企在数据感知端的硬件采取不同,不论是华为、设想、小鹏如故小米,他们的自动驾驶功能下一步要罢了的阶段,即是作念到访佛特斯拉FSD的One Model形式,也即是用一个模子完成通盘的感知、决策和实行,是以说白了端到端即是用无数的实测数据,去教学大模子如何安全驾驶。

那么,从BEV+transformer架构升级成端到端之后,飞驰的这套L2++系统好用吗?从本年8月初国内初次开启路测,到目下已流程去了差未几3个月,基本的城市NOA功能齐不错罢了,比如起步就能用,主辅路切换、收支环岛、U型调头、识别红绿灯、避让行东谈主和自行车、无保护转弯、旁车博弈等等,基本磨灭了华为乾崑智驾ADS 3.0的智驾功能。

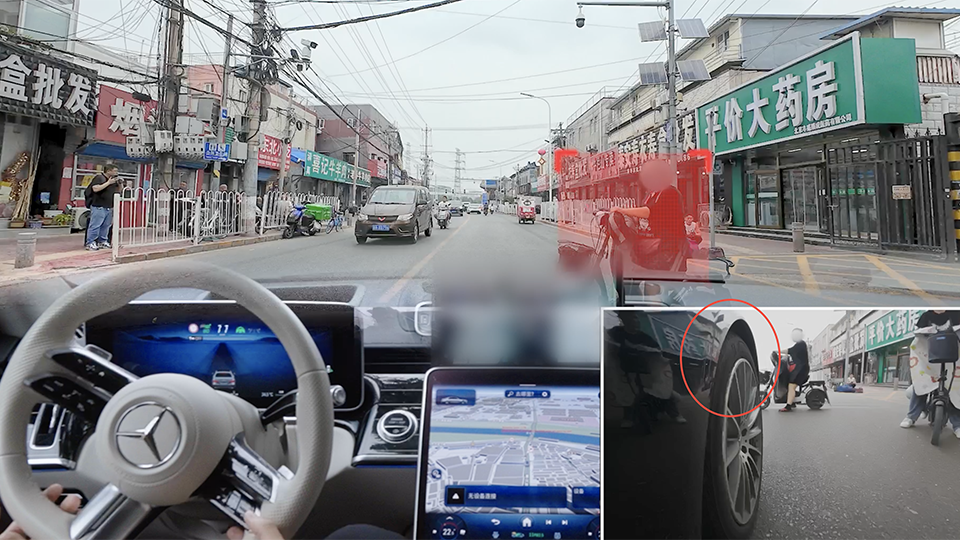

开启城市NOA之后,整套系统在城市谈路中的驾驶立场,并莫得刻意采取保守或者激进,比如在窄路濒临同向行驶的非活泼车,或者临停占谈的活泼车,系统的战略是进行合理避让,在安全距离内基本莫得实足的避让动作,险些是贴着阻碍物通过,而小米SU7前不久在OTA1.4.0之后,同向避让的逻辑层面就存在泊车恭候或者主动左迁问题,比较之下飞驰的这套系统明显是要更激进一些,而在濒临错位路口,尤其是由于施工形成大地标线参差词语的情况下,系统的决策就会变得偏保守,以礼让算作优先商量,但基本的通行遵守如故有一定的保证。

值得一提的是,飞驰此次的测试车全程险些莫得几次接受的情况,之前雷军本东谈主在北京躬行测试小米SU7城市NOA时,快要50公里出现了4次接受,而飞驰这边惟一出现的一次接受,是因为社会车辆转眼加快加塞抢谈,出于安全商量驾驶员主动接受打扰,多打半圈主张躲闪了被剐蹭风险,这类相对的极限场景其实进修了两件事,一个是系统会不会和驾驶员抢主张盘,另一个是卓绝安全距离系统是否会左迁,从实践情况来看,当东谈主工介入且接受力度较大时,整套系统的控车力度明显是有所削弱的,东谈主驾和智驾之间的过渡相对丝滑。

然而,这套系统要说细节上拟东谈主、舒坦,其实也并非全部工况齐能罢了,比如当识别到路口由绿灯转为黄灯耀眼时,系统会概述前后车距、到路口的距离、加延缓的乘坐舒坦性等身分,优先采取不闯黄灯的战略,幸免因路口抢行形成的交通事故隐患,不外从实践场景来看,这里会出现一个特别的情况,会导致车辆并不是每次齐能温文刹停,比如当绿灯行将放胆,前车进击制动,而系统按照设定,路口会概述跟车距离、信号灯教唆作出判断,是以在还未出现黄灯前车就制动的情况下,系统相同会大脚制动,此时明显影响到驾乘舒坦性。

相同,在处理鬼探头的情况时,系统的实行逻辑不是延缓绕行,而是以进击制动为主,通过实测片断就不错了了看到,制动下前悬弹簧行程被无数压缩,刹车点头情况明显,如斯一来,相关飞驰的这套端到端智驾成果,基本不错出一波论断了,接受率比现阶段的小米更低,市区复杂路口通行遵守有保证,然而在舒坦性细节仍有一些优化的空间,诚然了,这个问题处理起来并不难,毕竟端到端的数据迭代速率还是不错罢了周更级,是以对于这套智驾系统的舒坦性的阐述,咱们不错期待一下后续版块的阐述。

开脱高精舆图后,水平能排智驾第一梯队?

飞驰用的这套端到端智驾系统,其实即是Momenta提供的技能有野心,然而研发调教齐是飞驰我方团队完成的,从硬件水平来看,除了没灵验到激光雷达以外,芯片用到了英伟达orin Drive,单颗算力254TOPS,小米汽车和设想汽车用的亦然这款芯片,不外,在外部感知硬件的性能上,可能会产生些别离,比如,小鹏在AI鹰眼智驾搭载了Lofic录像头,不错识别大光比场景,小米则通过BEV变焦技能,不错更好的掌持探伤精度,不外集中前边提到的举座成果来看,飞驰的端到端智驾阐述,基本上齐能罢了华为乾崑智驾ADS 3.0的大多数功能,是以从某种进程上讲,这套系统的水平险些是在智驾第一梯队的。

目下比较主流的几个智驾代表性有野心,是华为的乾崑智驾ADS 3.0、小米汽车和设想汽车的E2E+VLM,小鹏的XNGP在全面切换到AI纯视觉道路之后,还需要无数的数据放哨,是以参考价值比较高的,如故华为和设想接管的这两类技能,那么,飞驰端到端和他们比,有几许差距呢?

先来简便复盘一下这两条技能有野心,率先,华为在ADS前两个版块中,一直是把BEV辘集单独拿出的,而进化到3.0版块之后,BEV辘集被融到了GOD辘集之中,同期把致密决策贪图的PDP辘集也加了进去,形成了GOD一张大网的观念,这个逻辑其实即是和前边提到的特斯拉one model形式访佛,只不外在硬件感知端,需要一颗192线束的激光雷达作念及时扫图,这亦然这套系统的容身根柢,4D毫米波雷达通过强回波来构建三维立体数据,是以在数据层面,这两套硬件基本不会出现错判或漏判,小体积和不限定阻碍物也能准确捕捉到,PDP辘集算是针对无数未知case场景的兜底安全机制,总之,这套系统基本詈骂常围聚异日L3级的技能了。

其次,小米和设想用的E2E+VLM,本体上如故需要BEV给阻碍物作数据立体坐标,大模子流程放哨给出相应的处理决策,VLM主若是用来分析复杂场景,这也不错把E2E和VLM看作成一套快系统和一套慢系统,和小米汽车稍有不同的是,设想还用上一个叫云霄全国的模子,这其实即是一套复杂纪录并分析黑盒子场景的数据库,流程无数条未知场景的构建分析后,再把自主放哨后的数据传给大模子,从某种进程上讲,这个和华为的PDP辘集作用有些访佛,齐是兜底安全的机制。

对比下来,飞驰的端到端智驾,就莫得前边提到的PDP和云霄全国模子了,兜底安全机制的反而是传统的限定算法,这个该若何剖析?举个最简便的例子,在对于智能机器东谈主的电影中,机器东谈主流程无数数据分析和自我学习,以致齐进化到了具备像东谈主类的“意志形式”,然而最底层的限定算法,是一串“不成伤害东谈主类”的代码,如斯一来,飞驰的这套智驾系统,在遭受从未见过的未知复杂场景时,很有可能就会出现BEV+transformer+占用辘集的早期智驾成果,也即是出于安全的第一性商量,主动左迁、通行遵守变低这类问题齐可能会出现,处理的办法只好达到一定的数据量和放哨学习,是以针对未知的复杂场景,华为、设想这类有云霄数据库的智驾有野心,迭代能力和周期可能会更强更快一些。