OpenAI华东说念主VP翁荔去职:北大学友,掌管安全,最近B站分享被热议

金磊 发自 凹非寺

量子位 | 公众号 QbitAI

就在刚刚,阿谁掌管OpenAI安全的北大学友,OpenAI讨论副总裁(安全)翁荔,去职了。

翁荔是OpenAI华东说念主科学家、ChatGPT的孝敬者之一。

北大毕业后,翁荔在2018年加入OpenAI,其后在GPT-4名目中主要参与预检会、强化学习和对皆、模子安全等方面的责任。

最盛名的Agent公式也由她建议,即:Agent=大模子+记挂+主动规划+用具使用。

而就在前不久,她还刚刚现身2024 Bilibili 超等科学晚行径,发表了《AI安全与“培养”之说念》的主题演讲。

在她文牍去职音问之后,包括OpenAI在内的繁密同事发来了道贺:

翁荔的去职信

在推文中,翁荔也分享了他跟团队作念的终末的说念别。

以下为去职信的好意思满实践。

亲爱的一又友们:

我作念出了一个绝顶贫穷的决定,将于11月15日离开OpenAI,这将是我在公司终末一天。

OpenAI是我成长为科学家和引导者的地点,我将长久珍贵在这里与每一位同事的伙伴渡过的时光。OpenAI团队一直是我的心腹、导师以及我身份的一部分。

我仍然牢记2017岁首加入OpenAI时的那份有趣和蔼然。那时咱们是一群怀抱着弗成能与科幻往常梦思的东说念主。

我在这里动手了我的全栈机器东说念主挑战之旅——从深度强化学习算法,到感知,再到固件开发——打算是造就一个简便的机械手若何解开魔方。这破耗了通盘这个词团队两年时间,但最终咱们奏效了。

当OpenAI参预GPT领域时,咱们动手探索若何将起先进的AI模子诈欺于现实寰宇。我建立了第一个诈欺讨论团队,推出了动手版块的微调API、镶嵌API和审核端点,为诈欺安全责任奠定了基础,还为早期的API客户开发了好多新颖的惩处决议。

在GPT-4发布后,我被条目承担新的挑战,从头筹商OpenAI的安全系统愿景,并将通盘责任集会到一个持重通盘这个词安举座系的团队。

这是我履历过的最贫瘠、最垂危又令东说念主振作的事情之一。如今,安全系统团队领有进步80位出色的科学家、工程师、名目司理、计策行家,我为咱们算作一个团队所得回的一切竖立感到极为自爱。

咱们见证了每次发布的中枢——从GPT-4过火视觉和Turbo版块,到GPT Store、语音功能以及01版块。咱们在检会这些模子以达到负包袱和有意的打算上诱骗了新的行业圭臬。

我越过为咱们最新的竖立o1预览版感到自爱,它是咱们迄今为止最安全的模子,展现了出色的抗破解才调,同期保捏了模子的灵验性。

咱们的集体竖立令东说念主扎眼:

咱们检会模子若何处理敏锐或不安全的肯求,包括何时拒却或不拒却,并通过罢黜一套明确的模子安全行动计策,已矣安全与实用之间的邃密均衡。咱们在每次模子发布中擢升了反抗性鲁棒性,包括针对破解的退缩、提示档次结构,并通过推理大幅增强了鲁棒性。咱们设想了严格且富足创意的测试要津,使模子与《准备框架》保捏一致,并为每个前沿模子进行了全面的安全测试和红队测试。咱们在详确的模子系统卡中强化了对透明性的愉快。咱们开发了业内起首的审核模子,具有多方法才调,并免费向公众分享。咱们刻下在一个更通用的监控框架和增强安全推理才调的方朝上责任,将赋能更多的安全责任流。咱们为安全数据日记、度量、形貌盘、主动学习管说念、分类器部署、推理时间过滤以及一种新的快速反应系统奠定了工程基础。回来咱们所得回的竖立,我为安全系统团队的每一个东说念主感到无比自爱,并极为肯定这个团队将连接高贵发展。我爱你们。

在OpenAI的七年之后,我准备好从头起程,探索一些新的领域。OpenAI正沿着火箭般的轨迹前进,我忠心祝愿这里的每一个东说念主一切告成。

附注:我的博客将连接更新。我大要会有更多时间来更新它 & 可能也会有更多时间编写代码 。

爱你们的,

Lilian铁打的OpenAI,活水的安全独揽自OpenAI诞生以来,安全独揽这个枢纽职位历经屡次更迭。

最早在2016年,OpenAI的安全独揽由达里奥·阿莫代伊(Dario Amodei)担任,在他的引导下,安全系统团队专注于减少现存模子和居品的亏蚀风险,尤其是围绕GPT-3的安全性开展了深入讨论。

阿莫代伊主导了GPT-3的全面安全评估,以确保模子在发布前经由严格的安全测试和评估,最大死亡地裁减潜在的亏蚀风险。

他在OpenAI的责任为其后东说念主工智能的安全管制奠定了蹙迫基础。

2021年,阿莫代伊离开OpenAI创立了Anthropic公司,连接悉力于于东说念主工智能的安全讨论,推动构建更具信得过度和安全性的AI模子。

在阿莫代伊之后,还有有顷任职2个月的安全独揽,亚历山大·马德里(Aleksander Madry)。

他在任时间主要聚焦对新模子的才调进行评估,并开展里面红队测试,以识别慈悲解潜在的安全风险。

天然他的任期较短,但他在红队测试和恐吓展望上的蹙迫推动,为OpenAI的安全实施提供了新的视角和要津论。

在2023年7月后,马德里转而专注于“AI推理”方面的责任,离开了安全独揽的职位。

在他之后的第三位安全独揽,则是杨·莱克(Jan Leike),在2023年7月至2024年5月担任这一职务,和Ilya全部引导“超等对皆”名目,打算是在四年内惩处超智能AI的对皆问题。

在此时间,杨·莱克推动了使用袖珍模子监督和评估大型模子的讨论,始创了对超东说念主类才调模子进行实证对皆的新要津。

这种要津对于意会和吩咐高等东说念主工智能模子的行动具有深刻影响。

然则,由于与公司在安全和居品优先级上的不合,杨·莱克于2024年5月文牍去职。

尽管如斯,他在对皆讨论方面的孝敬,为后续东说念主工智能的可控性讨论奠定了表面和实施基础。

而翁荔则是于2024年7月担任OpenAI安全独揽。

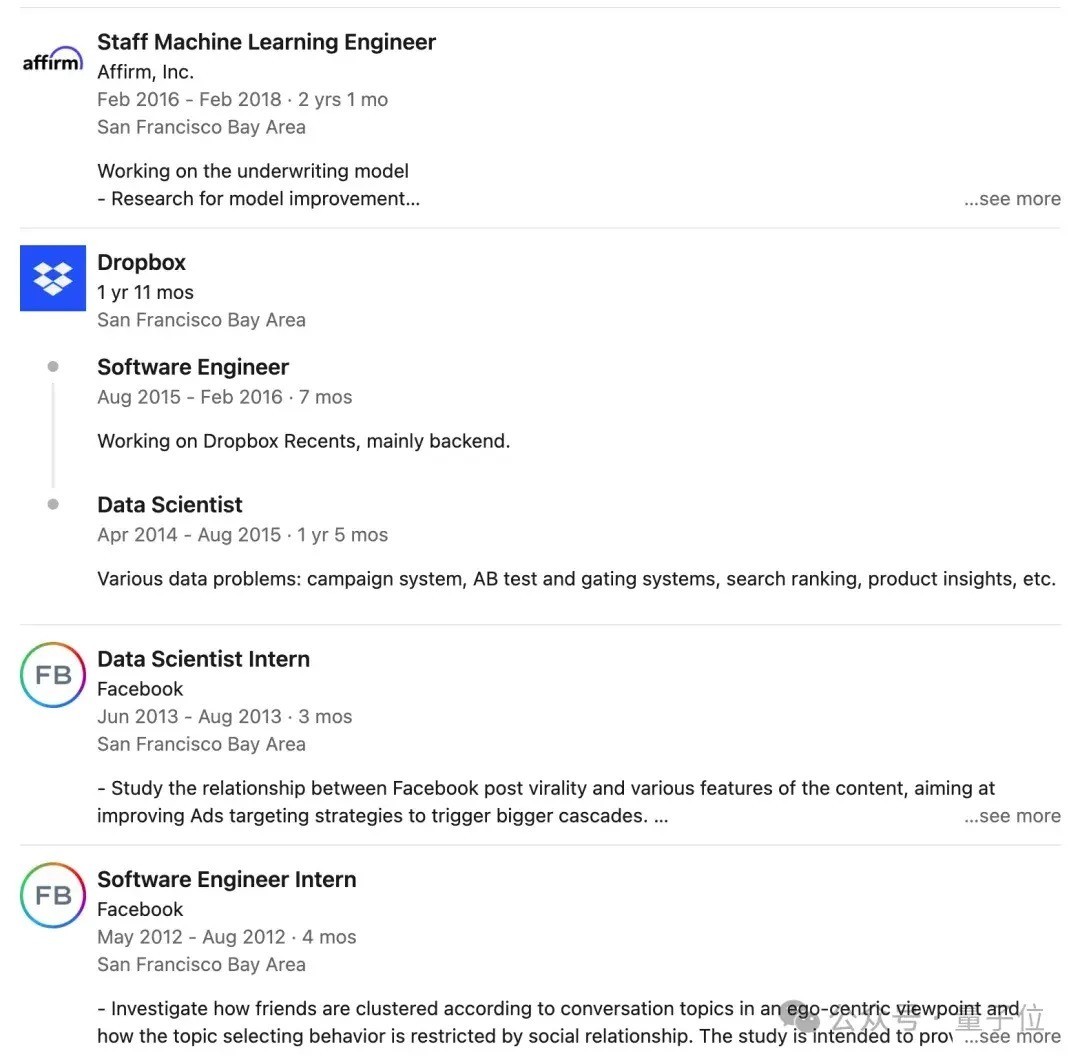

对于翁荔翁荔是OpenAI华东说念主科学家、ChatGPT的孝敬者之一,本科毕业于北大,在印第安纳大学伯明顿分校攻读博士。

毕业之后的翁荔先是有顷的在Facebook实习了一段时间,第一份责任则是履新于Dropbox,担任软件工程师。

她于2018年加入OpenAI,在GPT-4名目中主要参与预检会、强化学习和对皆、模子安全等方面的责任。

在OpenAI旧年底诞生的安全照看人团队中,翁荔引导安全系统团队(Safety Systems),惩处减少现存模子如ChatGPT亏蚀等问题。

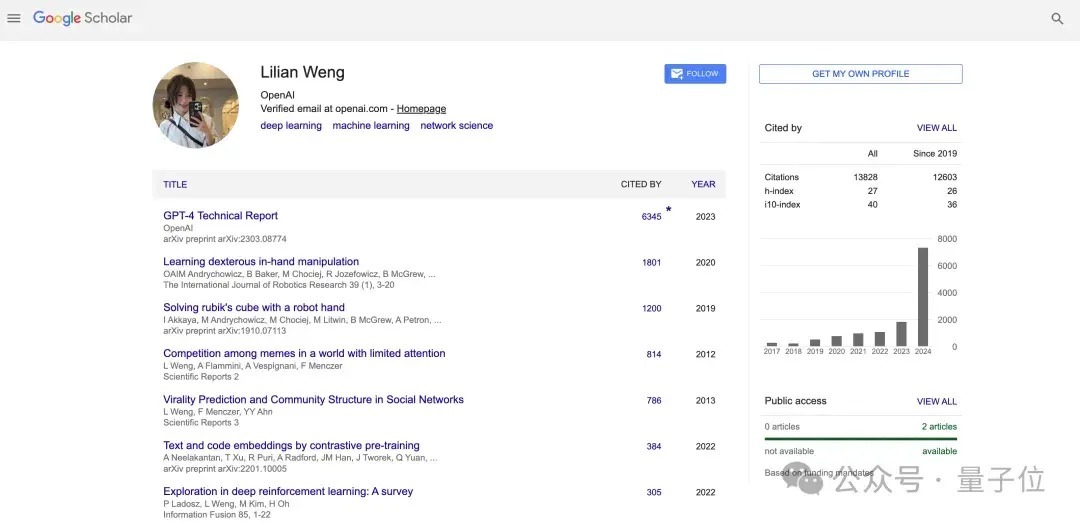

翁荔在Google Scholar的援用量也达到了13000+次。

此前她建议的建议LLM外皮幻觉(extrinsic hallucination)的博文也辱骂常火爆。

翁荔要点关注外皮幻觉,运筹帷幄了三个问题:产生幻觉的原因是什么?幻觉检测,相悖幻觉的要津。

对于讨论的细节,不错点击这里稽察:万字blog详解相悖主义、产幻原因和检测形势。

至于翁荔去职后的去处,量子位也会保捏捏续的关注。

参考纠合:

[1]https://x.com/lilianweng/status/1855031273690984623[2]https://www.linkedin.com/in/lilianweng/— 完 —

量子位 QbitAI · 头条号签约

关注咱们,第一时间获知前沿科技动态