Keras之父,去职谷歌

刚刚,谷歌官方文告了一条重磅音信:

Keras之父François Chollet,崇敬去职。

这篇著述由谷歌两位VP(包括谷歌刚挖来的华东谈主Bill Jia)共同撰写,抒发了对这位在谷歌长达9年零3个月的AI大佬,在责任上的招供及去职的怅然。

从内容上来看,谷歌先是确定了Keras这个深度学习框架咫尺取得的收获——

依然成为东谈主工智能发展的基石,用户数目朝上200万,简化了复杂的责任历程,让顶端期间变得顺手可取。

何况这项期间果决得到了庸碌地应用,从Waymo的自动驾驶,到YouTube、Netflix和Spotify的保举等。

不外天然François已去职,但他同意将连续参与Keras将来的发展,还将连续复旧JAX、TensorFlow和PyTorch上的责任。

而谷歌的Keras团队,则将连续与François的开源社区保执归拢。

至于François最新的动向,谷歌和其本东谈主松手咫尺并莫得骄傲。

而网友们关于François的去职却张开了一番浓烈的盘考。

举例从Keras的发展近况来看,有东谈主认为它在谷歌依然不香了:

我曾在某处看到,将来TensorFlow可能不会得到积极设备,谷歌里面转向了JAX;TensorFlow确凿依然输给了 PyTorch。

针对谷歌在官宣中对Keras给出的评价,有网友示意:

要是在2018年,这是事实;但当今,PyTorch的受宽饶进程远高于TensorFlow,其中很大一部分原因与LLM相关。

而从François个东谈主动向方面来看,有网友估计他可能被Anthropic挖了墙角……

Keras:为东谈主类联想的深度学习

Keras:为东谈主类联想的深度学习Keras最早不错追想到2015年,是由François发布的一个开源神经蚁集库。

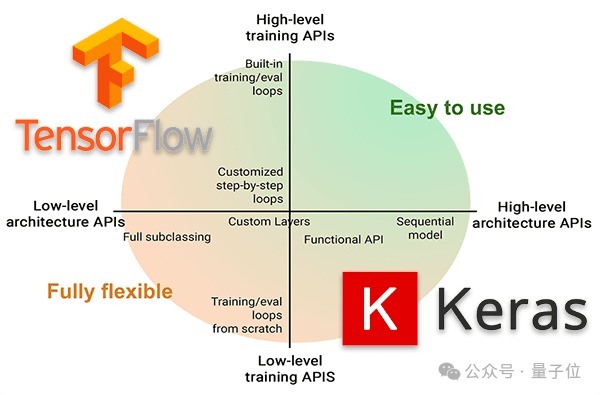

它当先的地方是提供一个高档深度学习API,用来简化深度学习模子的构建和实验过程。

因为在Keras出现之前,深度学习设备平素需要奏凯使用底层库(如Theano),用户需要编写大皆复杂代码才智构建一个基础的神经蚁集模子。

而Keras的出现可谓是篡改了这一时势。

它通过模块化和直不雅的API让深度学习的构建历程大大简化,极地面裁汰了参加深度学习畛域的门槛。

正如它官方给我方的定位那般:

为东谈主类联想的深度学习。

Keras一开动是孤独于具体狡计引擎的高档库,复旧Theano、Microsoft CNTK和TensorFlow行动其底层后端。

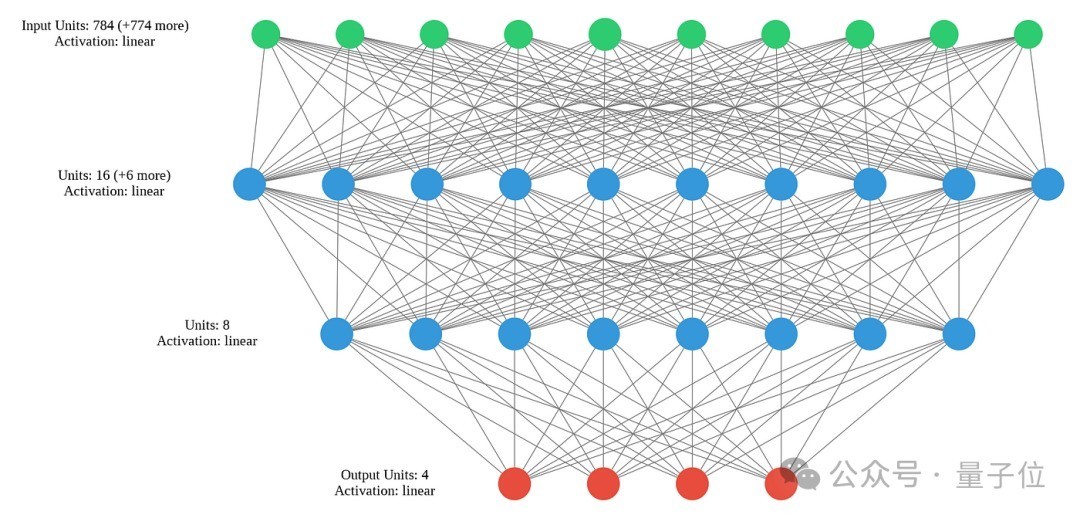

在期间上,Keras经受模块化的联想,用户不错通过组合不同类型的层(如全结合层、卷积层、轮回层)来快速搭建复杂的模子。

模子的西宾、考证和测试过程通过和洽的接口完了,设备过程不错说短长常顺畅。

Keras提供了Sequential API用于线性堆叠模子层,自后又引入了Functional API,来复旧复杂的非线性采聚合构和多输入多输出模子的构建。

这些特点让Keras不仅相宜浅薄的原型联想,还大致应酬执行坐蓐中的复杂需求。

但跟着TensorFlow的快速发展,二者之间的关系变得越来越详尽。

到了2017年,Keras被谷歌聘用成为TensorFlow官方的高档API。

在TensorFlow 2.0于2019年发布之后,Keras透澈集成到了TensorFlow中,成为其默许的模子构建用具。

这秀雅着Keras从一个孤独的高档库革新为TensorFlow的一部分。

这么作念的公正天然是有的。

首先,Keras不错无缝调用TensorFlow的底层功能,从而提供更高的性能和可推广性。

其次,TensorFlow提供了诸如GPU加快、TPU复旧、分散式西宾等高性能特点,整合后的Keras也大致冒失期骗这些特点。

这种革新不仅增强了Keras的功能,还使得它更适用于坐蓐环境的大畛域应用。

但是,跟着整合的鞭策,Keras行动孤独库的脚色渐渐淡化,tf.keras成为TensorFlow官方高档 API,也成为深度学习社区的圭臬聘用之一。

除此以外,行动深度学习框架演变的缩影——TensorFlow和PyTorch之间的竞争,也一定进程上触及到了Keras的发展。

PyTorch是由Facebook AI Research在2016年推出。

它的中枢上风在于动态狡计图(Dynamic Computational Graph),不错让代码实践得愈加活泼,设备者不错像编写普通Python代码相似进行模子的构建和调试。

比拟之下,早期的TensorFlow经受静态狡计图(Static Computational Graph),尽管实践后果较高,但在模子设备阶段的活泼性和调试便利性方面失态于PyTorch。

这种期间各异使得PyTorch衰退受到计划东谈主员的喜欢,尤其是在实验和快速迭代等责任中。

为了减弱与PyTorch在活泼性方面的差距,TensorFlow 2.0引入了与其雷同的动态图功能,通过Eager Execution和 tf.function 提供了更为活泼的设备体验。

这一演变使得TensorFlow在保执高性能优化的同期,也具备了PyTorch式的设备活泼性。

但此举似乎并未透澈弥补与PyTorch在用户体验上的差距。

天然,Keras这边亦然在不休迭代优化。

举例在旧年年底,Keras发布了3.0版块,被誉为篡改了机器学习游戏轨则。

不仅复旧TensorFlow、PyTorch、Jax三大框架行动后端,还能在它们之间无缝切换,致使夹杂使用。

François那时在我方的酬酢账号中概述了这么作念的四大公正,包括:

弥远让模子获取最好性能

解锁多个生态系统

在开源社区扩大影响力

使用任何源泉的数据pipeline

不外即便如斯,像Cohere机器学习总监Nils Reimers也给Keras敲了个警钟:

但愿历史不要重演。

Reimers认为,Keras当先从复旧单个后端(Theano)开动,不竭添加了Tensorflow、MXNet和CNTK等多后端。

这激励了一系列问题:

某些功能只在特定后端可用

各个后端的狡计收尾存在不一致:在一个后端上运行正常的代码,在另一个后端可能产生不同收尾

关于开源软件设备者来说体验倒霉:你刚完成了一个自界说的 Keras层念念要共享?你是否舒坦为其他后端再行完了和优化它呢?

调试问题:代码在一个后端上进展圆善,但在另一个后端的最新版块上却时时出错…

跟着时刻推移,这些问题愈发严重:某些模块只可在 Theano 上运行精湛,某些只适用于Tensorflow,还有一些模块不错在MXNet上进行推理,但无法西宾…

我但愿这一次的多后端能有更好的进展,但这无疑仍是一个挑战。

80后法国AI大牛提到Keras之父,François Chollet这个名字在AI圈里不错说是无人不晓。

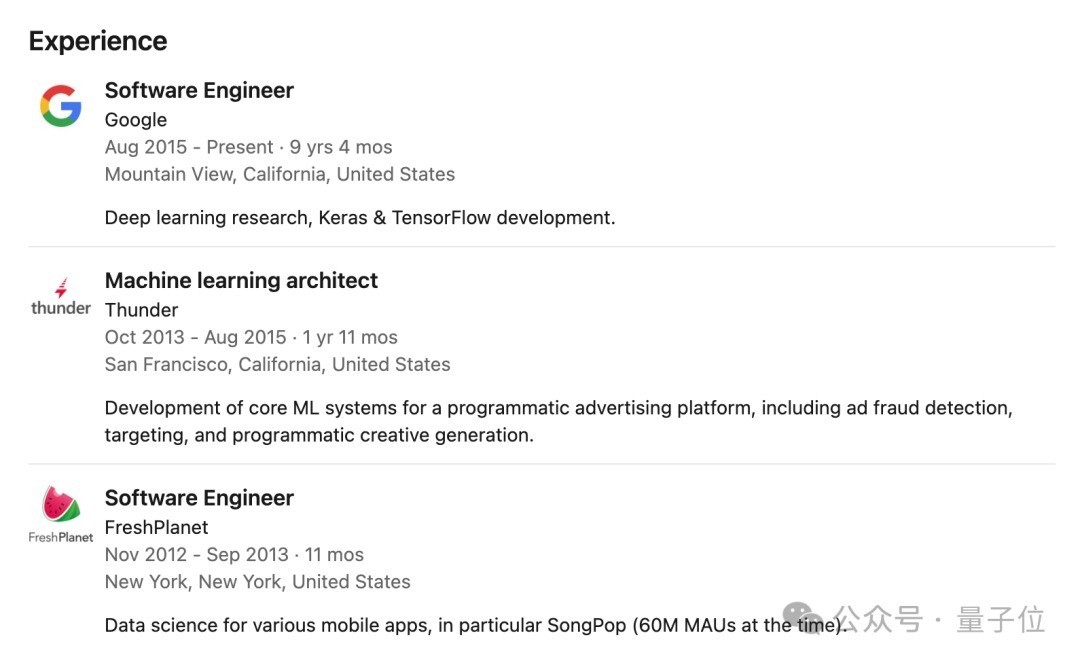

他成就于1989年10月20日,从经验上来看,他在2012年取得巴黎详尽理工学院工程硕士学位之后,并莫得聘用连续深造,而是赶赴好意思国赴任。

François先后分辩在FreshPlanet和Thunder分辩担任软件工程师和机器学习架构师;终末于2015年加入谷歌,直于今天。

在与国际着名访谈博主Lex Fridman疏通过程中,François也回来了Keras成就的故事。

在2014年,那时候最受宽饶的深度学习库如故用C++编写的Caffe(贾扬清出品),那时Caffe要比Theano更受宽饶。

而到了年底,François短暂对轮回神经蚁集产生了浓厚的兴致。

那时,这如故一个相对小众的畛域,于是他便开动寻找相宜的用具进行探索。

在参与Kaggle比赛期间,François尝试了诸如Torch7和Theano等用具,也使用过Caffe,但那时Caffe并莫得提供理念念的轮回神经蚁集处分决议,举例穷乏可叠加使用的开源LSTM完了。

于是乎,François便有了一个念念法,我方动手构建一个框架。

他当先的念念法是主要谈判在LSTM和RNN的完了上,且使用Python来编写。

期间一个相称垂危的决定是——模子将通过Python代码来界说。

这不错说是与那时的主流念念法是以火去蛾中,因为像Caffe、Theano这么的库平素使用YAML等静态配置文献来界说模子。

但其实有些库是用代码界说模子的,举例Torch7(但不是Python)。

而在François此前的责任实践中,scikit-learn这个开源深度学习库深得他的情意,因此他从中获取了大皆的灵感。

用他的话来说便是,Keras确凿便是为神经蚁集打造的scikit-learn。

有敬爱的是,Keras这个名字,如故François他在发布今日临时定下来的。

何况François还坦言:

几个月后我加入谷歌,其实跟Keras莫得任何相关。

我那时加入了一个计划团队,专注于图像分类和狡计机视觉畛域,因此当先在谷歌的责任东要是进行狡计机视觉计划。

刚加入谷歌时,我战役到了TensorFlow的早期里面版块,它迷惑我的原因在于它是Theano的纠正版。那一刻,我就意志到必须把Keras移植到这个全新的TensorFlow上。

尔后,也便是有了Keras与TensorFlow集成的故事。

至于除了此次去职的动作以外,François上一次步入全球的视频,如故一次访谈。

在此次访谈中,他示意狡计用100万好意思元搞AGI竞赛。

至于原因,是因为他合计现存的AI期间,尤其是LLM,主要依赖于缅想和效法东谈主类数据中的形式,在新情境下的新推理和技巧获取方面进展欠安。

其实早在2019年,François就提议了ARC-AGI ——惟一斟酌AGI能否有用获取新技巧并处分灵通式问题的评估圭臬。

咫尺,最好的AI系统在ARC基准测试中的得分为34%,而东谈主类包括儿童在内均能冒失得分85%。

因此ARC Prize饱读吹开源归拢,以擢升新念念法的产生率,增多发现AGI的契机,并确保这些新念念法得到庸碌传播。

至于François下一步的动向,量子位也将连续保执缓和。

参考邻接:

[1]https://developers.googleblog.com/en/farewell-and-thank-you-for-the-continued-partnership-francois-chollet/[2]https://news.ycombinator.com/item?id=42130881[3]https://time.com/7012823/francois-chollet/[4]https://en.wikipedia.org/wiki/François_Chollet[5]https://www.linkedin.com/in/fchollet/[6]https://keras.io/keras_3/— 完 —

报名行将截止!

「2024东谈主工智能年度评比」

量子位2024东谈主工智能年度评比将于11月15日截止报名,评比从企业、东谈主物、产物三大维度建立了5类奖项。

宽饶扫码报名评比!评比收尾将于12月MEET2025智能将来大会公布,期待与数百万从业者共同见证荣誉时刻。

科技前沿进展日日再会 ~