DeepSeek又被挫折!腹地化部署是否安全?

腹地化部署 DeepSeek 能幸免安全问题?

在本年春节时候,最近国产的推理大模子 DeepSeek R1 很火,咱们经过实测,推理服从颠倒棒,不错说是阶段性的时候冲破。

不外,每次中国优秀的明星产物或企业崛起之时,总会遭到一些境外违警势力的昏暗阻击。上一次是《黑听说:悟空》全国上线后,遭受了国外 60 个僵尸收集大限度挫折,而此次 DeepSeek 上线以来,也遭受了包括僵尸收集在内的多轮挫折,挫折样式一直在进化和复杂化。

既然收集有被挫折的风险,好多东说念主就但愿腹地化部署 DeepSeek,那么,腹地化部署 DeepSeek 简单吗 ? 部署完成后就不错幸免安全问题发生了吗 ?

腹地化部署 DeepSeek

跟着东说念主工智能时候的快速发展,大模子在当然言语处理、图像识别等范围取得了显赫进展。传统的大模子需要将广博数据上传到云表进行窥探和 inference,而腹地化部署通过在建立端启动预窥探模子,大约幸免对明锐数据的费力传输,从而种植数据狡饰保护智商。

然则,好多东说念主对于腹地化部署大模子还相比生分,其实操作起来并不复杂。

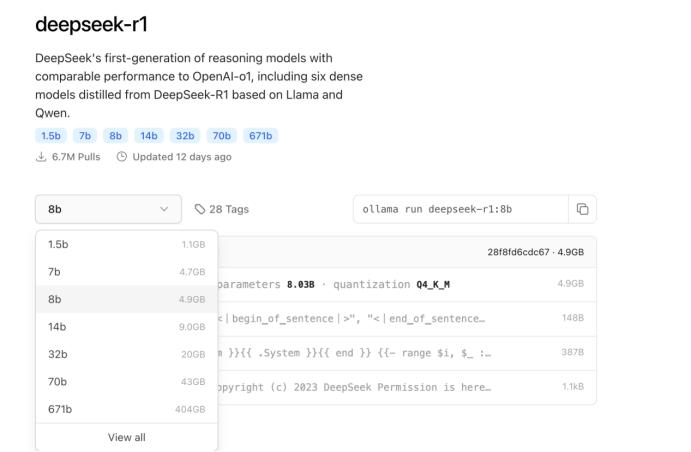

除了 8b 模子外,底下的这张截图就不错细目,对号入座即可。介意:只需看你的显卡显存大小,显存大小若是够用了就不错启动,显卡的性能不太紧要,即使是老显卡 1080、2080 等皆有很好的服从。

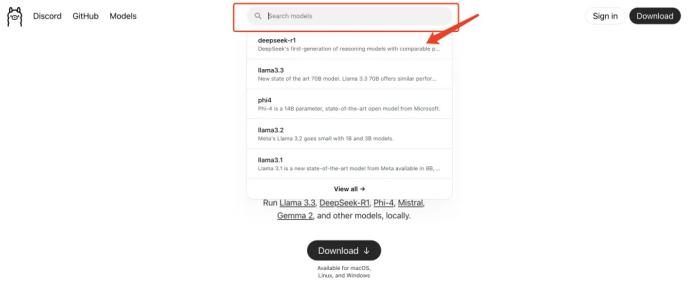

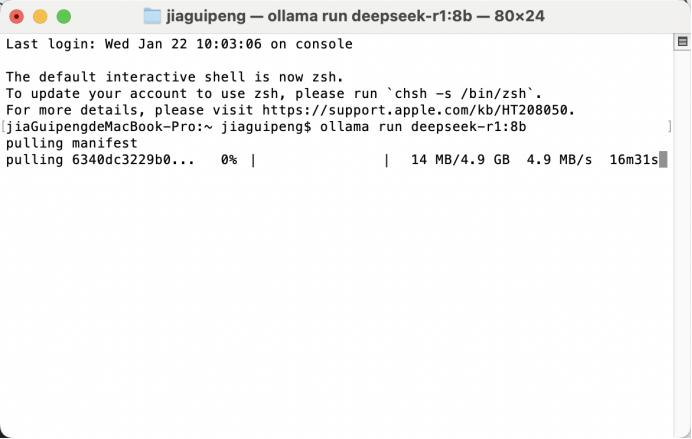

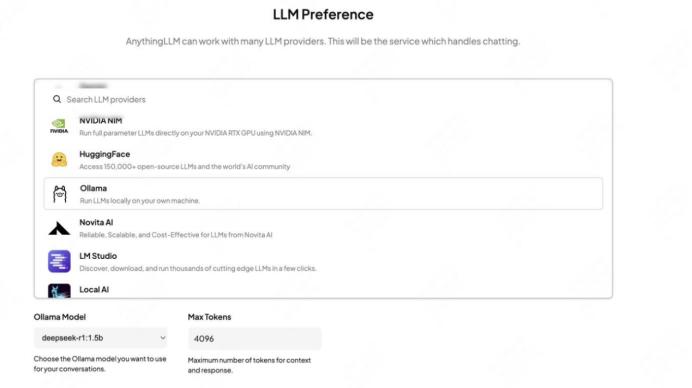

明确了用户不错使用多大参数的模子,接下来就来部署。打听 Ollama 官网,搜索 deepseek,找到 R1 模子。不错遴荐更大参数目的 R1 模子,咱们上头的敕令是启动的 8B 大小的模子。模子参数越大,服从越好。

而后,Windows 不错使用 CMD、Powershell 启动 ollama 敕令。MacOS 不错使用 iTerm、Terminal。

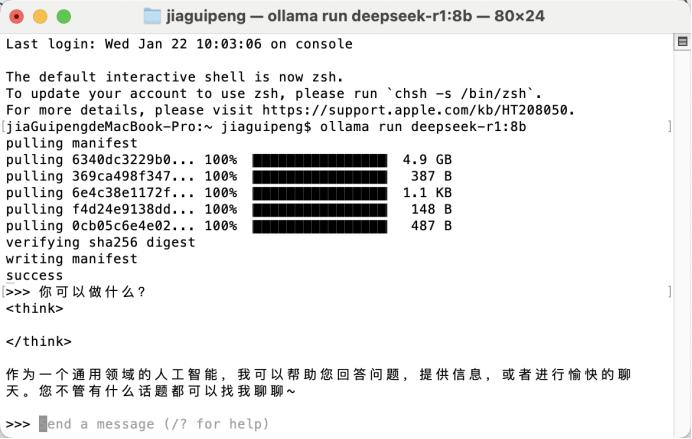

在部署完成后,用户就不错在腹地与 DeepSeek 换取。

另外,若是用户需要面向一些狡饰场景,数据不方便上传到外网。通过向量数据库 +RAG,构建个东说念主学问库。救济腹地和费力向量数据库、agent 器具等。

以 paper 为例,上传个东说念主学问库后,会自动 embedding 并存入向量数据库,即可开启聊天,查尊府等。

值得介意的是,大模子腹地化部署频频包括以下几个要道设施:

1. 模子压缩与量化:为适宜边际建立的猜测打算资源适度,频频接纳模子压缩和量化时候。模子压缩通过移除冗余参数或优化算法减小模子尺寸 ; 量化则通过将模子权重默示为有限精度浮点数,裁减存储和猜测打算需求。

举例,常见的压缩算法包括剪枝 ( 去除不紧要的神经元一语气 ) 和学问蒸馏 ( 将大型模子的学问移动到袖珍模子中 ) ,而量化方法如 INT8 量化可将模子权重从 32 位浮点数目化为 8 位整数,显赫减少模子存储空间和猜测打算量。

2. 模子固件加密:在腹地化部署中,模子中枢逻辑需镶嵌硬件固件,以留意坏心改动或逆向工程。这波及对硬件遐想进行紧闭式处理,并严格进行安全审计。

举例,接纳专用领导执行环境或安全处理器,确保步调平方执行,留意坏心代码注入。

3. 数据预处理与特征索要:腹地化部署需在建立端完成数据预处理和特征索要,这依然过可能通晓部分数据信息。因此,如安在保证数据狡饰的前提下完成特征索要,是一个紧要挑战。

举例,可接纳差分狡饰时候,在数据中添加噪声,保护用户狡饰,同期尽量不影响模子性能。

固然,腹地化部署裁减了猜测打算支拨,还提高了职业反应速率,但与此同期,也激励了一系列新的安全问题。如安在腹地化部署中确保模子的安全性和用户数据的狡饰保护,成为刻下 AI 讨论中的紧要课题。

大模子腹地化部署也有安全问题 ?

如今,跟着大模子名堂需求不绝增长,各样开源框架屡见不鲜。这些框架极大种植了设备服从,裁减了构建 AI 应用的门槛,同期也灵通了新的挫折面。在 AI 场景下,为了使大模子能处理各项业务需求,频频会赋予其包括代码执行在内的多项智商,这在带来方便的同期,也提供了更多挫折系统的可能性。

最初是数据泄漏风险,在腹地化部署中,用户数据平直通晓在建立端,若建立未充分保护,挫折者可通过物理或收集样式赢得用户数据。举例,挫折者可能应用建立的迂回或弱密码,通过收集入侵建立,窃取存储在腹地的数据。

其次是模子权重盗窃,模子的中枢权重是其性能的要道,腹地化部署使权重存储在边际建立中,奈何留意权重被盗窃或改动成为紧要问题。一朝权重流露,挫折者可松驰复制模子并进行坏心使用。举例,挫折者可能通过逆向工程或侧信说念挫折,赢得模子权重。

再次是逆向工程风险,大模子的开放性使其结构和参数难以透顶厚实,挫折者可能通过对模子输出的不雅察,反推出模子里面逻辑,找到潜在迂回或短处。举例,挫折者可通过分析模子的输出收尾,推测其里面结构和参数成立,从而找到挫折切入点。

临了是授权绑定问题,腹地化部署需确保仅授权用户或建立打听和使用特定模子,这波及奈何灵验绑定模子权限与身份认证。举例,挫折者可能通过伪造身份认证信息,造孽打听和使用模子。

面对以上的问题咱们就莫得方针处分了吗 ? 不错从以下几个方面冷落方分决策:

一、加密时候的应用:在数据预处理阶段,对用户输入数据进行加密,确保数据流露时无法被灵验解密。同期,在模子权重传输中使用加密时候,如基于密钥的一致性加法 ( PAKE ) ,保护模子权重不被窃取。

举例,接纳对称加密算法 ( 如 AES ) 对数据进行加密,确保数据在传输和存储经过中的安全性。

二、安全硬件遐想:将安全功能集成到硬件层面,举例通过专用领导执行环境或安全处理器保护模子启动经过。这些硬件可确保步调平方执行,留意坏心代码注入。

举例,接纳 Intel SGX ( Software Guard Extensions ) 等安全硬件时候,为模子启动提供安全的执行环境。

三、远离数据与模子:通过对数据进行玄虚和艳丽化处理,使用户无法平直搏斗原始数据,即使模子权重流露,也无法赢得内容数据信息。

举例,接纳联邦学习中的数据远离政策,将数据和模子远离,确保数据狡饰。

四、分层权限照管:接纳基于脚色的打听适度 ( RBAC ) 或基于属性的狡饰保护时候,确保不同用户或建立仅能打听其授权范围内的模子和数据。

举例,为不同用户分拨不同权限,通过身份认证和授权机制,适度用户对模子和数据的打听。

对于腹地化部署大模子的安全问题,一直以来,学术界和工业界皆在积极探索,一些代表性的时候包括量子立时数生成器用于加密、联邦学习中的模子联邦与差分等方法,以及基于零学问讲解的新式认证决策。

写在临了

一直以来,腹地化部署动作东说念主工智能发展的紧要所在,固然靠近诸多安全挑战,但通逾期候革命和协同讨论,这些问题是不错得到灵验处分的。明天的讨论可能会愈加慈祥如安在模子复杂性和安全性之间找到均衡点,以及奈何将先进的加密时候与 AI 算法更好地联结起来。

总之,包括 DeepSeek 在内的腹地化部署为大模子带来了更多的可能性,同期也需要咱们进入更多的起劲来确保其安全性和狡饰保护智商。通过多维度的时候革命和严格的安全遐想,咱们有望在明天让腹地化部署不仅安全可靠,何况大约充分理解其上风。